Emily Bender, la académica de la IA convertida en escéptica de la IA: "Los chatbots no son más que máquinas de plagiar"

Publicado el 23/06/2025 por Diario Tecnología Artículo original

En 2021 el mundo aún no se había enterado de lo que se le venía encima, pero Emily Bender —lingüista y profesora de la Universidad de Washington— lo tuvo muy claro. Fue entonces cuando copublicó un famoso estudio en el que calificó a los modelos de IA existentes como "loros estocásticos". Aquella expresión se convirtió desde entonces en una de las mejores formas de definir el funcionamiento básico de ChatGPT. Y cuatro años después esta experta se reafirma en su posición: es una escéptica con argumentos.

Loros estocásticos. La idea fundamental de su analogía era la de comparar a los modelos que había entonces (entre ellos GPT-3, precursor del usado en ChatGPT) como loros estocásticos. Lo de "loros" está claro, ya que los modelos básicamente repiten lo que se les dice a través del entrenamiento. Lo de "estocásticos", un término no tan conocido, se refiere a que los LLM no repiten de forma determinista o fija, sino que predice probabilísticamente cuál es la siguiente palabra más probable en una secuencia basándose en el contexto.

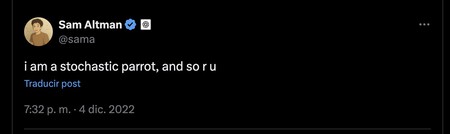

¿No lo somos los humanos? Sam Altman recogió el guante un año después, cuando la expresión ya era conocida. Lo hizo el 4 de diciembre de 2022, cuatro días después de que ChatGPT saliera al mercado. Quiso así tratar de hacernos ver que según él al final los seres humanos también éramos loros estocásticos. En cierto sentido lo somos: aprendemos patrones del lenguaje y repetimos frases que oímos además de predecir lo que viene a continuación en una conversación. Sin embargo hay diferencias críticas con los modelos de IA.

- Entendemos lo que decimos, mientras que los LLM no

- Tenemos conciencia e intencionalidad al hablar, no solo producimos secuencias probables

- Tenemos razonamiento abstracto y somos capaces de adaptar razonar, generalizar y corregir nuestros errores de forma flexible: nuestro pensamiento no es puramente estadístico

Escéptica declarada. Emily Bender no ha cambiado de parecer en todos estos años. De hecho, acaba de publicar su libro, 'The AI Con' (algo así como 'El timo de la IA') en el que precisamente desarrolla los argumentos en los que basa sus reservas y su escepticismo respecto a la inteligencia artificial. En una reciente entrevista con Financial Times, Bender destacaba que los chatbots de IA no son más que "máquinas de plagiar" y que los grandes modelos de lenguaje (LLMs) en los que se basan "han nacido siendo una mierda".

Nos han vendido una mentira. Esta experta cree que las empresas de IA generativa nos han vendido una mentira. Sus modelos, afirma, no cumplirán esas promesas, pero tampoco acabarán con la raza humana, como algunos han querido advertir. A pesar de toda la expectación generada, en su opinión los chatbots son malos en la mayoría de tareas e incluso los mejores modelos de la actualidad siguen sin contar con algo parecido a la inteligencia.

Y de "razonar", nada. Los nuevos modos de "razonamiento" que plantean modelos como o1, o3 o DeepSeek R1 son en su opinión otra mentira, y esa afirmación de que entienden el mundo no tiene sentido. Estamos "imaginando una mente tras los textos [generados]", explica, "pero todo ese entendimiento viene de nuestro lado", no del de la IA.

No es inteligencia, es automatización. Bender, que en la actualidad tiene 51 años, pasó sus primeros años académicos en Stanford y Berkeley, y acabó trabajando como profesora en la Universidad de Washington, donde se ha especialziado en cómo las computadoras modelan en lenguaje humano. En su opinión el propio nombre de inteligencia artificial es exagerado —un viejo debate—, y debería llamarse simplemente automatización.

Los chatbots controlados por el poder. En su libro 'The AI Con' ella y su coautor, Alex Hanna, advierten del peligro de los modelos de IA actuales. Sobre todo porque están controlados por grandes empresas con ciertos intereses. "Gracias a las enormes sumas invertidas, una minúscula camarilla de hombres tiene la capacidad de influir en lo que sucede a grandes franjas de la sociedad, explica.

Demasiado hype. Y frente a los discursos y promesas de Altman o Amodei, que prometen que llegaremos a la AGI pronto o que la IA reemplazá a millones de trabajadores, la visión de Bender es mucho más escéptica. Para ella no es más que un "bonito envoltorio para las hojas de cálculo", pero ni hay magia ni tampoco una mente emergente.

Una bola 8 mágica con pretensiones. Su visión escéptica va en contra de la de personalidades como Sam Altman o Elon Musk, que no paran de prometer todo tipo de revoluciones. "Que todo el mundo crea que esto [la IA] sea una entidad pensante va en su beneficio y muy potente", explica, "en lugar de lograr que la gente piense que esto no es más que una bola 8 mágica con pretensiones", apuntando a este juguete que agitas realizando una pregunta y te contesta con un "sí", "no", "depende" o algunas opciones más.

Imagen | Wikimedia | Village Global

utm_campaign=23_Jun_2025"> Javier Pastor .