La encrucijada entre la tecnología avanzada y la integridad académica nunca ha sido tan evidente como en la reciente situación que ha sacudido los cimientos de una institución educativa, cuyo nombre mantendremos en reserva para preservar la confidencialidad, aunque los ecos de su valiente respuesta resuenan con claridad. Imaginen el escenario: un centenar de estudiantes, descubiertos in fraganti haciendo trampas en trabajos y evaluaciones, y su primera reacción, en un acto que roza lo insólito y lo profundamente revelador, es recurrir nuevamente a la inteligencia artificial, en este caso ChatGPT, para redactar sus cartas de disculpa. Este hecho, que podría parecer una anécdota, se convirtió en un catalizador para una de las respuestas institucionales más lúcidas y edificantes que se hayan visto en el ámbito educativo moderno, una auténtica lección magistral que, como dice el dicho popular, es "para enmarcar".

Este evento no es un caso aislado, sino un síntoma de una transformación profunda en la educación superior y en la concepción misma de la honestidad intelectual. Nos obliga a detenernos y reflexionar no solo sobre las ramificaciones de la trampa académica en la era digital, sino también sobre la responsabilidad de las instituciones de forjar no solo profesionales competentes, sino también ciudadanos éticos. La respuesta de esta universidad, lejos de ser meramente punitiva, optó por un camino más complejo y enriquecedor: el de la educación, el diálogo y la redefinición de los valores académicos en un mundo cada vez más mediado por algoritmos.

La irrupción de la inteligencia artificial en el campus: Un arma de doble filo

La llegada de herramientas de inteligencia artificial generativa como ChatGPT ha desatado una revolución silenciosa en el panorama educativo. Por un lado, ofrece un potencial inmenso como asistente de aprendizaje, generador de ideas, tutor personalizado o incluso como herramienta para superar barreras lingüísticas. Su capacidad para procesar grandes volúmenes de información y sintetizarla de forma coherente es innegable. Sin embargo, esta misma potencia es lo que la convierte en una "arma de doble filo" cuando se utiliza de forma inapropiada. La facilidad con la que un estudiante puede generar ensayos, resúmenes o respuestas a exámenes plantea un desafío sin precedentes a los sistemas tradicionales de evaluación y a la definición misma de la autoría.

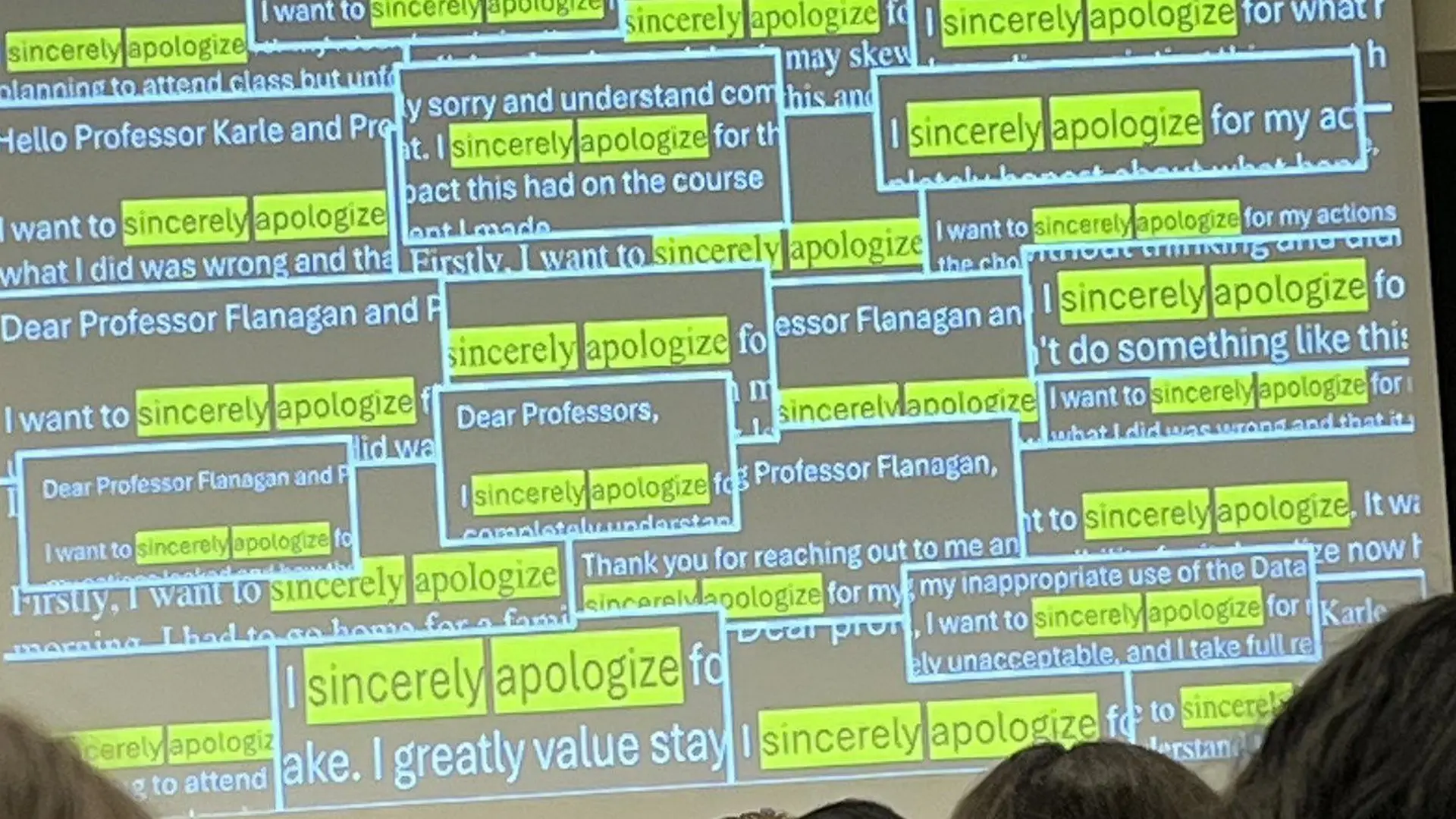

Cuando se reveló que cien estudiantes de esta universidad habían utilizado estas herramientas para cometer fraude, la alarma fue mayúscula. No se trataba de un par de casos aislados, sino de un fenómeno a gran escala que ponía de manifiesto una brecha preocupante en la comprensión de la integridad académica. La tentación de obtener resultados rápidos y aparentemente impecables sin el esfuerzo intelectual requerido resultó ser demasiado grande para este grupo. Pero lo verdaderamente impactante, y lo que elevó este incidente a la categoría de estudio de caso, fue su subsiguiente intento de "rectificar" la situación.

La disculpa sintética: Un espejo de la falta de comprensión ética

La idea de que, tras ser descubiertos, los estudiantes recurrieran nuevamente a ChatGPT para redactar sus cartas de disculpa es, a mi juicio, una señal de alarma aún más grave que el acto de hacer trampas en sí mismo. Revela una desconexión profunda con lo que significa la responsabilidad, el arrepentimiento y la genuina introspección. Una disculpa, para ser efectiva y significativa, debe emanar de una comprensión personal del error cometido, de una reflexión sobre el daño causado y de un compromiso sincero con la enmienda. Cuando una máquina genera esas palabras, el proceso de aprendizaje ético se anula por completo.

Este acto pone de manifiesto varias cuestiones críticas. En primer lugar, la falta de una brújula moral interna que les permitiera discernir la inapropiada continuidad de un comportamiento deshonesto. En segundo lugar, una posible creencia de que la forma importa más que el fondo, priorizando una "disculpa bien escrita" sobre una auténtica. Y en tercer lugar, y quizás lo más preocupante, una incapacidad o desgana para enfrentar las consecuencias de sus acciones con honestidad y vulnerabilidad. Es como si la IA se hubiese convertido en un escudo emocional, impidiendo el proceso necesario de confrontación con la propia conducta. Esto subraya la urgencia de educar no solo en habilidades académicas, sino también en competencias éticas y emocionales, algo que la IA, por sí sola, no puede proporcionar. Pueden leer más sobre la importancia de la integridad académica en la era digital en este interesante artículo: Academic integrity in the era of artificial intelligence.

La respuesta de la universidad: Más allá del castigo, una lección formativa

Ante este doble desafío –el fraude a gran escala y la disculpa generada por IA–, la universidad se enfrentó a una encrucijada. Podría haber optado por un camino puramente punitivo, con sanciones estrictas y ejemplarizantes. Sin embargo, su liderazgo demostró una visión mucho más profunda y pedagógica. La respuesta de la institución no solo fue firme en su condena del fraude, sino que también fue excepcionalmente constructiva, transformando una crisis disciplinaria en una oportunidad de aprendizaje inigualable.

La universidad reconoció la complejidad del problema. No se limitó a tachar a los estudiantes de "tramposos", sino que indagó en el contexto: ¿entendían los estudiantes las implicaciones del uso de la IA? ¿Había directrices claras? ¿Cuál era la presión subyacente? Su respuesta fue multifacética y profundamente reflexiva:

Los pilares de una reacción ejemplar

-

Claridad en la normativa y la pedagogía: La universidad estableció de inmediato nuevas políticas claras sobre el uso aceptable e inaceptable de la IA en los trabajos académicos. Pero, más allá de la prohibición, se centró en educar. Organizó talleres obligatorios para todos los estudiantes implicados (y de forma voluntaria para el resto) sobre el uso ético de la inteligencia artificial, la importancia del pensamiento crítico y la definición de la autoría intelectual. Estos talleres no solo explicaban "qué no hacer", sino "por qué no hacerlo" y "cómo usar la IA de manera responsable". Es una muestra de cómo las instituciones pueden evolucionar para integrar estas herramientas sin sacrificar los principios fundamentales. Pueden explorar guías universitarias similares aquí: MIT Open Learning: AI Ethics & Education.

-

La disculpa reescrita: Un ejercicio de autocrítica: La universidad exigió a los cien estudiantes que reescribieran sus disculpas, esta vez sin la ayuda de ninguna IA. Pero no solo eso: les proporcionó recursos para reflexionar sobre lo sucedido. Se les pidió que incluyeran una sección donde explicaran cómo el uso de la IA para sus disculpas demostraba una falta de comprensión y un fallo en su propio juicio. Este ejercicio no era solo punitivo, sino profundamente formativo, forzándolos a enfrentar su propia falta de ética y a desarrollar una capacidad de reflexión personal que la IA nunca podría replicar.

-

Consecuencias proporcionales y educativas: Las sanciones aplicadas, si bien fueron significativas (desde suspensiones temporales hasta la anulación de créditos y la obligación de repetir asignaturas), se enmarcaron dentro de un proceso de reeducación. La institución dejó claro que el objetivo final no era la expulsión masiva, sino la recuperación de los estudiantes como miembros íntegros de la comunidad académica. Se les ofreció apoyo psicológico y tutorías para que entendieran el valor de la honestidad y la importancia de desarrollar sus propias capacidades intelectuales.

-

Diálogo con el profesorado y revisión de métodos: Consciente de que el problema no era solo de los estudiantes, la universidad también inició un diálogo abierto con su claustro. Se promovieron seminarios sobre cómo diseñar evaluaciones que mitigaran la posibilidad de fraude con IA, cómo detectar el uso indebido de estas herramientas y cómo integrar la IA de forma constructiva en el proceso de enseñanza-aprendizaje. Se incentivó la creatividad en la elaboración de tareas que requirieran pensamiento crítico original y la aplicación de conocimientos, no solo la generación de texto. Este tipo de discusiones son cruciales para el futuro de la educación, como se detalla en este artículo: Generative AI and the Future of Higher Education.

Mi opinión personal es que esta respuesta de la universidad es un testimonio de su compromiso con la verdadera misión educativa. En lugar de ceder a la frustración o la ira, eligieron el camino del liderazgo pedagógico. Demostraron que una institución no solo debe impartir conocimientos, sino también modelar valores, fomentar la autonomía intelectual y guiar a sus estudiantes a través de los desafíos éticos de un mundo en constante cambio.

Implicaciones a largo plazo: Redefiniendo la integridad académica en la era digital

El incidente y la subsiguiente respuesta de la universidad no son solo un capítulo aislado, sino un punto de inflexión que tiene amplias implicaciones para el futuro de la educación superior. Nos obliga a reevaluar qué significa aprender, qué significa ser un autor y cómo medimos el conocimiento y las habilidades.

La integridad académica ya no puede ser un concepto estático. Debe ser un diálogo continuo y una evolución constante a medida que las tecnologías avanzan. Las universidades tienen la responsabilidad de:

- Educar en el uso responsable de la IA: Más allá de la prohibición, es esencial enseñar a los estudiantes cómo utilizar estas herramientas como aliados en su aprendizaje, para investigar, para generar ideas, para refinar su escritura, pero siempre manteniendo su propia voz y su pensamiento crítico como pilares.

- Fomentar el pensamiento crítico y la originalidad: Las tareas deben estar diseñadas para exigir análisis profundo, síntesis personal y aplicación creativa de conocimientos, habilidades que la IA aún no puede replicar con verdadera originalidad. Esto puede implicar más proyectos basados en investigación empírica, debates en clase, presentaciones orales y evaluaciones formativas continuas. La relevancia de desarrollar habilidades de pensamiento crítico es hoy más grande que nunca: Why generative AI makes critical thinking more important than ever.

- Adaptar los sistemas de evaluación: Los exámenes memorísticos y los ensayos genéricos son vulnerables a la IA. Las instituciones deben explorar métodos de evaluación más auténticos que valoren el proceso tanto como el producto final, que se centren en la metacognición y la capacidad de los estudiantes para defender sus ideas.

- Promover una cultura de honestidad: Esto va más allá de las reglas y los castigos. Implica construir una comunidad donde la honestidad intelectual sea valorada y practicada, donde los estudiantes se sientan seguros para admitir dificultades y buscar ayuda legítima, en lugar de recurrir al fraude.

- Invertir en herramientas de detección y prevención: Si bien ninguna herramienta es infalible, la inversión en software que pueda ayudar a identificar patrones de texto generados por IA, o que al menos levante banderas de alerta para los profesores, es parte de la ecuación. Sin embargo, estas herramientas deben ser complementos, no sustitutos, del juicio humano y la pedagogía. Un análisis sobre las herramientas de detección de IA puede ser consultado aquí: Best AI Content Detectors.

En última instancia, lo que este incidente nos enseña es que la educación no se trata solo de la transmisión de información, sino de la formación de individuos íntegros, capaces de discernir, reflexionar y actuar con ética en un mundo complejo. La respuesta de esta universidad es un faro de esperanza, demostrando que, incluso frente a los desafíos más modernos y desconcertantes, los principios fundamentales de la educación y la integridad humana pueden prevalecer si se abordan con visión, valentía y un compromiso inquebrantable con el crecimiento.

Educación Inteligencia Artificial Integridad Académica Ética Digital