En la era digital, donde la inmediatez y el impacto visual son claves para captar la atención del público, las instituciones se enfrentan al reto constante de modernizar sus estrategias de comunicación. El Ministerio del Interior, consciente de esta necesidad y con la intención de informar sobre un dispositivo de seguridad vial tan relevante como las balizas V16, dio un paso que, lamentablemente, se convirtió en un ejemplo de cómo la innovación tecnológica, sin la debida supervisión, puede generar más confusión que claridad. La publicación de una imagen generada por inteligencia artificial (IA) plagada de errores no solo desvió la atención del mensaje principal, sino que también abrió un debate crucial sobre la responsabilidad y la precisión en la comunicación institucional en la era de la IA. Este incidente, más allá de la anécdota, nos invita a reflexionar sobre la integración de estas herramientas en el ámbito público y las implicaciones que tiene para la confianza ciudadana.

Contexto: La baliza V16 y su relevancia para la seguridad vial

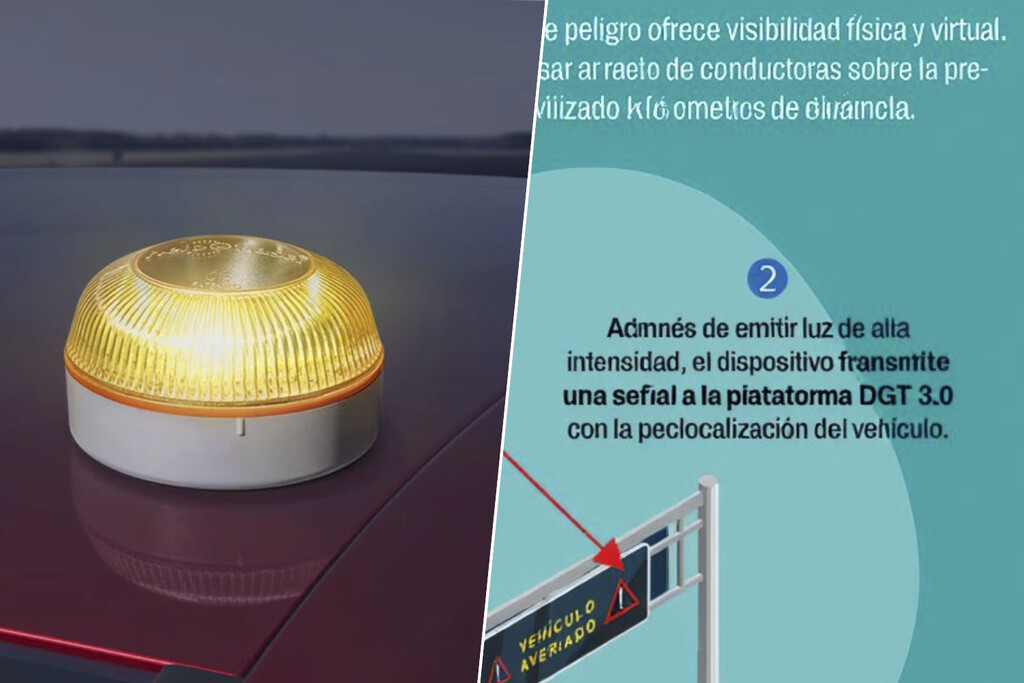

Antes de adentrarnos en la controversia, es fundamental comprender la importancia del dispositivo que el Ministerio del Interior intentaba promover. Las balizas V16 representan un avance significativo en la seguridad vial, destinadas a sustituir a los triángulos de emergencia. Su principal ventaja radica en la capacidad de ser colocadas en el techo del vehículo accidentado o averiado sin necesidad de que el conductor abandone el habitáculo, reduciendo drásticamente el riesgo de atropello. Equipadas con un sistema de geolocalización, estas balizas enviarán automáticamente la ubicación del vehículo a la Dirección General de Tráfico (DGT), permitiendo una asistencia más rápida y precisa. A partir del 1 de enero de 2026, su uso será obligatorio, aunque ya son una alternativa válida a los triángulos. La DGT ha trabajado activamente en difundir información sobre estas balizas, dada su vital importancia para salvar vidas en nuestras carreteras. Puedes encontrar más detalles sobre la normativa y sus características en la página oficial de la DGT sobre las balizas V16.

Este cambio normativo no es trivial; es una adaptación necesaria a las nuevas realidades del tráfico y a las tecnologías disponibles para proteger a los usuarios de la vía. La DGT, como organismo responsable, tiene la obligación de asegurar que esta información llegue a todos los conductores de manera clara, concisa y, sobre todo, precisa. Es aquí donde el uso de herramientas de comunicación visual, como las imágenes, juega un papel crucial. Una representación gráfica correcta puede simplificar conceptos complejos y asegurar que el mensaje sea comprendido sin ambigüedades.

La imagen en cuestión: Errores que delatan la generación por IA

El Ministerio del Interior, en su afán por comunicar eficazmente la implementación de las balizas V16, decidió emplear una ilustración. Sin embargo, lo que inicialmente pudo haber sido una buena intención, se transformó en un foco de críticas al evidenciarse que la imagen había sido generada por inteligencia artificial sin una revisión adecuada. Los errores no eran sutiles; eran flagrantes y fácilmente detectables por cualquier ojo mínimamente atento.

Entre los fallos más evidentes, destacaban las inconsistencias anatómicas en las manos de las personas representadas. Dedos con formas extrañas, cantidades incorrectas o proporciones desfiguradas son una señal inequívoca de las limitaciones actuales de la IA en la generación de imágenes fotorrealistas, especialmente en detalles humanos. Además, la escena global presentaba una calidad casi onírica, con elementos que carecían de la nitidez y coherencia propias de una fotografía o una ilustración humana bien ejecutada. Los vehículos, la carretera y el entorno parecían fusionarse o tener contornos imprecisos, creando una atmósfera irreal que chocaba con la seriedad del mensaje de seguridad vial.

Un error particularmente llamativo, y que revela la falta de supervisión humana, fue la ubicación de la baliza V16 en uno de los vehículos. Aparecía colocada de una forma poco práctica o incluso incorrecta, lo cual desvirtuaba completamente el objetivo de la imagen: mostrar el uso adecuado del dispositivo. Si la intención era educar sobre cómo usar una baliza V16, una imagen que la muestra mal utilizada, o en un contexto ambiguo, termina confundiendo más que informando. Este tipo de fallos no solo son estéticos; socavan la credibilidad del mensaje y de la institución emisora. Es una paradoja que, buscando claridad, se generara una imagen tan llena de imprecisiones.

El dilema de la información pública y la inteligencia artificial

El incidente del Ministerio del Interior con la baliza V16 es un microcosmos del debate más amplio sobre el uso de la inteligencia artificial en el sector público. La IA ofrece un potencial enorme para mejorar la eficiencia, la accesibilidad y la personalización de los servicios y la comunicación gubernamental. Desde la generación de textos para comunicados de prensa hasta la creación de material visual, las herramientas de IA pueden agilizar procesos y reducir costes. Sin embargo, este episodio subraya que el entusiasmo por la tecnología no debe eclipsar la necesidad de un enfoque crítico y una supervisión humana rigurosa.

Mi opinión personal es que, si bien la intención de modernizar la comunicación es loable, la implementación de nuevas tecnologías como la IA exige una fase de experimentación y un protocolo de revisión mucho más estricto, especialmente cuando se trata de información vital como la seguridad vial. No se puede confiar ciegamente en una máquina, por muy avanzada que sea, para generar contenido que requiere precisión factual y coherencia contextual. La IA es una herramienta, no un sustituto de la capacidad humana de discernimiento, juicio y verificación. El afán por subirse a la ola tecnológica no debe llevar a comprometer la calidad y la fiabilidad de la información que se transmite a los ciudadanos.

Repercusiones y la erosión de la credibilidad

La reacción a la imagen del Ministerio del Interior no se hizo esperar. Las redes sociales se llenaron de comentarios irónicos y críticas que señalaban los errores con un tono que oscilaba entre el humor y la decepción. Expertos en diseño gráfico, comunicación y, por supuesto, usuarios de a pie, analizaron la imagen y expusieron sus múltiples defectos. Lo que buscaba ser un mensaje informativo se convirtió en un meme y en un ejemplo de lo que no se debe hacer.

Esta situación generó una erosión en la credibilidad de la institución. Cuando un organismo oficial, encargado de la seguridad y el orden, difunde información con errores tan evidentes, se abre la puerta a la desconfianza. ¿Si no pueden asegurar la calidad de una simple imagen, qué tan fiables son otras informaciones? Este tipo de incidentes, aunque puedan parecer menores, contribuyen a una percepción de incompetencia o de falta de seriedad que puede tener consecuencias a largo plazo para la relación entre el gobierno y los ciudadanos. Para una visión más profunda sobre cómo estos errores pueden afectar la imagen pública, puedes consultar artículos sobre comunicación de crisis y reputación institucional.

El objetivo del mensaje, que era concienciar sobre la importancia de las balizas V16 y su correcto uso, quedó completamente diluido. En lugar de hablar de seguridad vial, la conversación giró en torno a la IA fallida. Es una oportunidad perdida para educar a la población sobre un tema crucial.

Estándares de calidad y verificación en la comunicación institucional

El incidente del Ministerio del Interior debería servir como un llamado de atención a todas las instituciones públicas sobre la necesidad de establecer estándares de calidad y procesos de verificación rigurosos para todo el contenido que se produce y difunde. Esto es especialmente cierto cuando se incorporan nuevas tecnologías como la inteligencia artificial, que aún se encuentran en una fase de desarrollo y perfeccionamiento constante.

La verificación humana no puede ser omitida. Antes de publicar cualquier material, sea texto, imagen o video, debe pasar por un equipo de revisión que no solo compruebe la precisión de la información, sino también la coherencia visual, la corrección estilística y la adecuación al tono y propósito del mensaje. En el caso de la IA, esto significa que un generador de imágenes puede ser un punto de partida, pero el resultado final debe ser evaluado, retocado o incluso descartado si no cumple con los estándares exigidos.

Además, es fundamental que las instituciones inviertan en formación para sus equipos de comunicación. Comprender las capacidades y limitaciones de la inteligencia artificial, saber cómo interactuar con ella de manera efectiva y desarrollar un ojo crítico para detectar sus "errores" es ya una habilidad esencial en el panorama comunicativo actual. Se trata de aprovechar la potencia de la IA sin renunciar a la inteligencia y el discernimiento humanos. Para más información sobre buenas prácticas en el uso de IA en el sector público, recomiendo leer este artículo sobre la ética de la IA en la administración pública.

Más allá del error: Lecciones aprendidas sobre la IA

Este episodio, más allá de la anécdota, nos ofrece valiosas lecciones sobre la integración de la inteligencia artificial en contextos sensibles y de alto impacto público. La primera y más evidente es que la IA, por muy sofisticada que parezca, es una herramienta. Una herramienta que puede ser poderosa y eficiente, pero que carece de la comprensión contextual, el sentido común y la capacidad de juicio crítico que posee un ser humano. No comprende las implicaciones de sus propias creaciones ni las consecuencias de los errores que pueda cometer.

La segunda lección es la necesidad de transparencia. Si bien el Ministerio no afirmó explícitamente que la imagen fuera generada por IA, su falta de calidad la delató. En un futuro, quizás sea prudente considerar si el contenido generado por IA debería ser etiquetado como tal, especialmente en el ámbito público. Esto podría gestionar las expectativas del público y fomentar una mayor responsabilidad por parte de las instituciones. Es una medida que puede contribuir a construir confianza, en lugar de socavarla. Personalmente, creo que la transparencia en el uso de IA es fundamental para evitar malentendidos y para que los ciudadanos sepan qué tipo de contenido están consumiendo.

Finalmente, este incidente destaca la importancia de una supervisión multidisciplinar. No solo comunicadores, sino también expertos en seguridad vial, diseñadores gráficos y especialistas en tecnología deberían haber revisado la imagen. La colaboración entre diferentes áreas es clave para asegurar que el mensaje no solo sea atractivo, sino también preciso, relevante y éticamente responsable.

El futuro de la comunicación de la DGT y el Ministerio

De cara al futuro, el Ministerio del Interior y la DGT tienen la oportunidad de aprender de este error y reforzar sus estrategias de comunicación. Esto implica no solo ser más cautelosos con el uso de la IA, sino también revisar sus procesos internos de producción y verificación de contenido. Podrían, por ejemplo, establecer un comité de ética de la IA que supervise el uso de estas tecnologías en sus campañas.

La comunicación sobre seguridad vial es demasiado importante para que se vea comprometida por errores evitables. La claridad, la precisión y la accesibilidad deben ser los pilares de cualquier mensaje. Invertir en profesionales de la comunicación con experiencia en diseño y verificación de contenido, y capacitar a sus equipos en el uso responsable de la IA, será crucial. La DGT ya tiene una presencia significativa en medios digitales y redes sociales, que puedes consultar en sus perfiles oficiales. Mantener un alto estándar de calidad en estas plataformas es fundamental para su misión.

Además, el episodio puede ser una excelente oportunidad para iniciar un diálogo público sobre cómo las instituciones deben abordar la IA. ¿Qué límites éticos deben imponerse? ¿Qué nivel de automatización es aceptable en la comunicación oficial? Estas son preguntas que requieren respuestas colectivas y el establecimiento de marcos de referencia claros. Este incidente, aunque vergonzoso, ha catalizado una conversación necesaria.

Conclusión: Un recordatorio sobre la cautela y la supervisión

La publicación de la imagen generada por IA con errores por parte del Ministerio del Interior para informar sobre las balizas V16 es un recordatorio contundente de que la innovación tecnológica, por sí sola, no garantiza el éxito. Al contrario, sin una supervisión humana crítica y un compromiso inquebrantable con la precisión y la calidad, puede conducir a errores que comprometen la credibilidad institucional y desvirtúan mensajes cruciales. En un ámbito tan sensible como la seguridad vial, donde la información puede literalmente salvar vidas, la claridad y la exactitud son primordiales.

Este incidente no debe desanimar el uso de la inteligencia artificial en el sector público, sino que debe servir como un catalizador para un enfoque más reflexivo, cauteloso y responsable. La IA es una herramienta potente, capaz de transformar positivamente la comunicación y la gestión, pero su integración exige un compromiso ético, una inversión en formación y, sobre todo, una supervisión humana constante. La confianza ciudadana es un activo invaluable que no debe ponerse en riesgo por la búsqueda de la novedad tecnológica sin el debido rigor. En última instancia, la tecnología debe servir a las personas y a la misión pública, y no al revés. Reflexiones sobre la IA responsable pueden encontrarse en este artículo sobre el desarrollo ético de la inteligencia artificial.

V16 Ministerio Interior Inteligencia Artificial Seguridad Vial