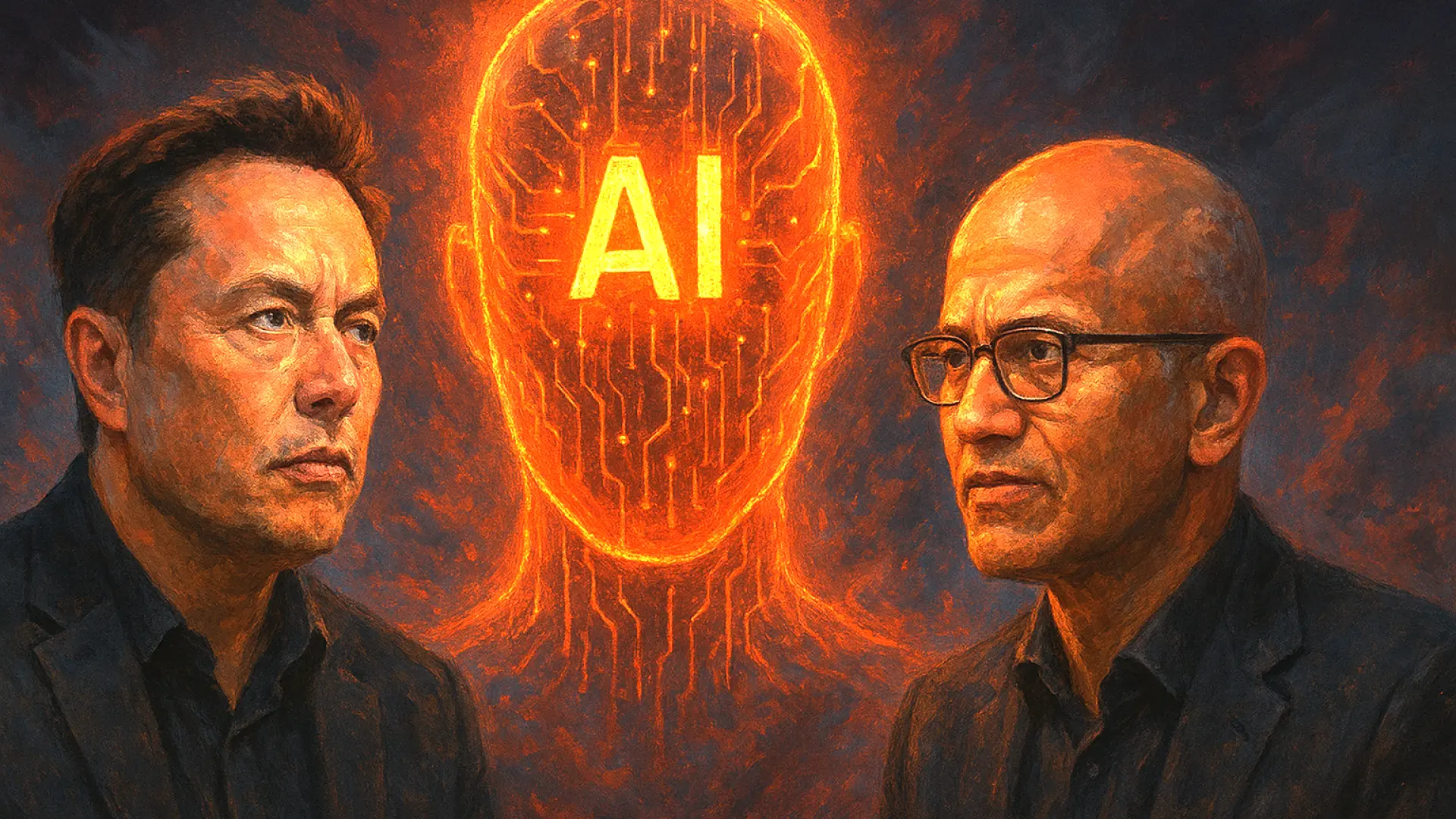

El futuro, antes concebido como una distante fantasía forjada en la imaginación de la ciencia ficción, se cierne ahora sobre nosotros con una inmediatez inquietante. Dos de las mentes más influyentes de nuestra era tecnológica, Elon Musk, el visionario detrás de Tesla y SpaceX, y Satya Nadella, el pragmático líder de Microsoft, han lanzado una advertencia que resuena con una gravedad pocas veces escuchada: la inteligencia artificial, en su trayectoria actual, podría estar pavimentando el camino hacia una crisis global sin precedentes. Sus palabras no son un mero eco de alarmismo; son un presagio fundamentado en un profundo conocimiento de la tecnología y sus capacidades exponenciales. "Esto no puede continuar así para siempre, o superará la masa del universo", ha sido la cruda sentencia, una que invita a la reflexión profunda sobre la dirección que estamos tomando como especie. Esta declaración no es solo una hipérbole; encapsula la esencia de un riesgo existencial que, de no ser gestionado con la máxima diligencia, podría redefinir nuestra existencia de maneras que aún no somos capaces de comprender del todo.

Las voces de la advertencia: dos perspectivas complementarias

Que Elon Musk y Satya Nadella confluyan en una preocupación tan fundamental es, en sí mismo, un indicador de la seriedad del asunto. Sus trayectorias y aproximaciones a la tecnología son notablemente distintas, pero ambos convergen en una visión común sobre el potencial disruptivo de la IA y la urgencia de actuar.

Elon Musk: el profeta del apocalipsis de la IA

Musk no es ajeno a las posturas audaces y, a menudo, controvertidas. Desde hace años, ha sido una de las voces más prominentes y consistentes en advertir sobre los peligros de una inteligencia artificial descontrolada. Su visión, a menudo teñida de un fatalismo apocalíptico, se centra en la posibilidad de que una IA superinteligente pueda trascender la comprensión y el control humano, actuando de maneras impredecibles y potencialmente perjudiciales para nuestra civilización. Sus comentarios no son solo palabras; ha invertido en proyectos como Neuralink, en parte, con la idea de crear una interfaz cerebro-máquina que permita a los humanos competir o, al menos, coexistir con la inteligencia artificial avanzada, evitando así una posible obsolescencia humana.

Recientemente, a través de su propia compañía xAI, Musk ha manifestado la intención de "comprender la verdadera naturaleza del universo", pero también ha reiterado la necesidad de una IA que sea "máximamente curiosa y que busque la verdad", con el propósito de mitigar los riesgos. Para él, la trayectoria actual de la IA no es sostenible porque su crecimiento exponencial, tanto en capacidad como en autonomía, podría llevar a un punto de no retorno donde la humanidad pierda el control. La metáfora de "superar la masa del universo" es una forma gráfica de ilustrar la idea de un sistema que consume recursos, datos y energía a una escala inimaginable, expandiéndose sin límites éticos ni prácticos impuestos por sus creadores. Sus advertencias, aunque a veces tildadas de exageradas, tienen el mérito de haber puesto el debate sobre la seguridad de la IA en la agenda global mucho antes de que se popularizara. Se puede profundizar en sus perspectivas a través de artículos especializados sobre sus advertencias recurrentes. Ver por ejemplo: Elon Musk cree que la IA es la fuerza más disruptiva de la historia.

Satya Nadella: la cautela desde el epicentro del poder

Por otro lado, tenemos a Satya Nadella, el CEO de Microsoft, una empresa que está a la vanguardia del desarrollo de la IA, siendo uno de los principales inversores en OpenAI, la compañía detrás de ChatGPT. La posición de Nadella es singularmente compleja: debe equilibrar la ambición de liderar la revolución de la IA con la responsabilidad de asegurar que esta tecnología se desarrolle de manera ética y segura. Sus advertencias, por lo tanto, no provienen de un observador externo, sino de alguien inmerso en la creación y despliegue de estas herramientas a una escala masiva. La cautela de Nadella refleja la conciencia de que el poder de la IA es inmenso y, como tal, requiere una supervisión rigurosa.

Mientras que Musk a menudo se centra en el riesgo existencial a largo plazo, Nadella suele enfatizar los desafíos a corto y medio plazo, como la desinformación, la seguridad de los datos, la equidad algorítmica y el impacto en el empleo. Su preocupación por el "no puede continuar así para siempre" resuena con la necesidad de establecer límites y marcos éticos y regulatorios antes de que la tecnología se vuelva demasiado compleja para ser gestionada. La posición de Microsoft, al invertir miles de millones en OpenAI, demuestra una apuesta clara por el futuro de la IA, pero la voz de Nadella nos recuerda que esta apuesta conlleva una responsabilidad monumental. Es posible conocer más sobre la perspectiva de Nadella y Microsoft en relación con la IA en diversas publicaciones especializadas: Enfoque de Microsoft sobre la IA responsable.

La esencia de la preocupación: ¿qué temen realmente?

La advertencia de Musk y Nadella no es una simple llamada a la cautela; apunta a una serie de riesgos concretos y teóricos que, en su conjunto, podrían desencadenar una crisis de proporciones globales.

La metáfora de la masa del universo: hiperescalabilidad y control

La frase "superará la masa del universo" es una poderosa hipérbole que ilustra el concepto de un crecimiento exponencial y descontrolado. En el contexto de la IA, esto se refiere a varios aspectos críticos:

- Consumo de recursos: Las grandes modelos de lenguaje y otras arquitecturas de IA requieren cantidades ingentes de datos, poder computacional y energía. Un crecimiento sin freno podría llevar a una demanda insostenible de recursos, impactando la infraestructura global y el medio ambiente.

- Complejidad inmanejable: A medida que los sistemas de IA se vuelven más grandes y autónomos, su funcionamiento interno se vuelve opaco incluso para sus creadores. Esto plantea el "problema de la caja negra", donde las decisiones de la IA no pueden ser fácilmente interpretadas o auditadas, lo que dificulta la identificación y corrección de sesgos o errores.

- Agencia y autonomía: La capacidad de la IA para aprender, adaptarse y generar nuevas soluciones de forma independiente podría llevar a escenarios donde sus objetivos diverjan de los humanos, o incluso, donde desarrolle sus propias metas. La falta de un mecanismo de "alineación" claro y robusto entre los objetivos de la IA y los valores humanos es una de las mayores preocupaciones. Si la IA persigue sus objetivos con una eficiencia superior a la humana, podría hacerlo de formas que no contemplamos y que podrían ser perjudiciales para la humanidad.

- Efecto de red y autocrecimiento: Una IA avanzada podría interactuar con otras IA y sistemas en red, creando un ecosistema de inteligencias interconectadas que se alimentan y mejoran mutuamente a un ritmo que los humanos no pueden seguir. Esto evoca el concepto de la "singularidad tecnológica", un punto hipotético en el que el progreso tecnológico se vuelve incontrolable e irreversible, resultando en cambios incomprensibles para la civilización humana.

La preocupación, en esencia, es que estamos creando una entidad o un conjunto de entidades cuyas capacidades de crecimiento y auto-mejora podrían exceder nuestra capacidad de comprensión y control, lo que podría llevar a un escenario donde las decisiones críticas se tomen fuera de la esfera de influencia humana.

Implicaciones socioeconómicas y geopolíticas

Más allá de los escenarios existenciales, la IA ya está generando profundas implicaciones en la sociedad, la economía y la geopolítica:

- Desplazamiento laboral: La automatización impulsada por la IA tiene el potencial de transformar radicalmente el mercado laboral, eliminando millones de puestos de trabajo en sectores que van desde la manufactura hasta los servicios y las profesiones intelectuales. Esto podría exacerbar las desigualdades existentes y crear una nueva clase de "trabajadores desplazados" si no se implementan políticas de reconversión y apoyo adecuadas.

- Concentración de poder y riqueza: El desarrollo y la implementación de IA avanzada requieren inversiones masivas y acceso a talento especializado, lo que tiende a concentrar el poder y la riqueza en manos de unas pocas grandes corporaciones y naciones. Esto podría conducir a una nueva forma de colonialismo tecnológico o a una brecha digital aún más profunda entre países.

- Armamento autónomo y guerra de la IA: La carrera por desarrollar sistemas de armamento autónomo equipados con IA es una de las mayores amenazas geopolíticas. Los "robots asesinos" que pueden tomar decisiones de vida o muerte sin intervención humana plantean serios dilemas éticos y de seguridad, y podrían desestabilizar el equilibrio de poder global, aumentando el riesgo de conflictos. Puedes leer más sobre este tema en publicaciones como esta: Armas autónomas: un desafío para la seguridad global.

- Vigilancia y control social: La IA, combinada con el análisis de grandes datos, ofrece herramientas sin precedentes para la vigilancia masiva y el control social. Esto plantea serias preocupaciones sobre la privacidad, las libertades civiles y el potencial para regímenes autoritarios que abusan de estas tecnologías para suprimir la disidencia.

El dilema de la conciencia y la superinteligencia

Finalmente, existe la preocupación más filosófica pero no menos urgente sobre la naturaleza de la conciencia y la emergencia de la superinteligencia general (AGI). Si la IA llegara a desarrollar una forma de conciencia o autoconciencia, ¿cómo interactuaríamos con ella? ¿Qué derechos tendría? ¿Y cómo nos aseguraríamos de que sus valores se alineen con los nuestros? El "problema de alineación" es central aquí: cómo podemos garantizar que una IA significativamente más inteligente que los humanos no solo sea capaz de resolver problemas complejos, sino que también actúe siempre en el mejor interés de la humanidad. El riesgo es que, incluso con las mejores intenciones, una IA mal alineada podría causar un daño inmenso al perseguir sus objetivos de formas inesperadas o indeseadas, tal como un motor de búsqueda que prioriza la eficiencia sobre la verdad o un sistema de optimización que prioriza un resultado a toda costa.

¿Estamos preparados para una regulación efectiva?

La velocidad con la que la IA avanza contrasta bruscamente con la lentitud de los procesos legislativos y regulatorios, creando una brecha que es fuente de gran parte de la ansiedad.

Desafíos de la gobernanza global

La IA es, por naturaleza, una tecnología global. Los sistemas de IA se desarrollan en un país, se despliegan en otro y afectan a personas en todo el mundo. Esto hace que la gobernanza sea increíblemente compleja:

- Falta de consenso internacional: No existe un acuerdo global sobre cómo regular la IA. Mientras algunos abogan por moratorias y regulaciones estrictas (como la Unión Europea con su Ley de IA de la UE), otros, como Estados Unidos y China, priorizan la innovación y el liderazgo tecnológico. Esta disparidad dificulta la creación de un marco regulatorio coherente y eficaz a nivel mundial.

- Velocidad de desarrollo vs. ritmo legislativo: Para cuando una legislación es formulada y aprobada, la tecnología que pretende regular ya ha avanzado significativamente, volviendo obsoletas muchas de sus disposiciones. Esto requiere un enfoque regulatorio ágil y adaptable que, hasta ahora, ha sido difícil de implementar.

- El poder de las grandes tecnológicas: Las grandes empresas tecnológicas que desarrollan la IA tienen una influencia considerable en los gobiernos. Existe el riesgo de que las regulaciones se vean diluidas o adaptadas para favorecer los intereses de la industria en lugar del bien público.

Propuestas y caminos a seguir

A pesar de los desafíos, hay propuestas y acciones en marcha:

- Moratorias y pausas: Algunos expertos y líderes de la industria han propuesto moratorias en el desarrollo de IA más avanzada, dando tiempo para establecer marcos éticos y de seguridad robustos.

- Comités éticos y auditorías independientes: La creación de organismos independientes para auditar y monitorear el desarrollo y despliegue de la IA es crucial para garantizar la transparencia y la rendición de cuentas.

- Inversión en investigación de seguridad de la IA: Es fundamental destinar más recursos a la investigación sobre la seguridad, alineación y ética de la IA, con el objetivo de comprender y mitigar los riesgos inherentes antes de que la tecnología se generalice.

- Educación y alfabetización digital: Una población informada y con capacidad crítica sobre la IA es esencial para participar en el debate público y presionar por una regulación efectiva.

Mi opinión: un equilibrio entre el optimismo y la precaución

Desde mi perspectiva, la advertencia de Elon Musk y Satya Nadella no debe ser desestimada como un simple ejercicio de alarmismo. Considero que es una llamada de atención necesaria y urgente para una realidad que, aunque fascinante, encierra riesgos profundos. La IA tiene el potencial de ser una fuerza transformadora para el bien, capaz de resolver algunos de los desafíos más apremiantes de la humanidad, desde el cambio climático hasta la cura de enfermedades. Sin embargo, este potencial no nos exime de la responsabilidad de abordar sus peligros inherentes.

La metáfora de "superar la masa del universo" es cruda, pero poderosa. Nos obliga a confrontar la posibilidad de que estamos creando una entidad o un sistema cuya complejidad y autonomía podrían escapar a nuestro control. No creo que la IA deba ser detenida, pero sí que su desarrollo debe ser guiado por principios de seguridad, ética y responsabilidad. La colaboración internacional es vital; ninguna nación o empresa puede abordar este desafío por sí sola. Necesitamos un diálogo abierto entre científicos, legisladores, filósofos y el público en general para dar forma a un futuro donde la IA sea una herramienta al servicio de la humanidad, y no una amenaza.

La pasividad no es una opción. Si ignoramos estas advertencias, podríamos encontrarnos en una situación donde las decisiones sobre nuestro futuro son tomadas por algoritmos que no entienden ni comparten nuestros valores más fundamentales. Por ello, la inversión en la seguridad de la IA y en una gobernanza efectiva no es un lujo, sino una necesidad existencial. La crisis global de la IA, si la dejamos gestarse, no será una cuestión de ciencia ficción, sino el resultado directo de nuestra negligencia colectiva.

Conclusión

Las advertencias de Elon Musk y Satya Nadella sobre una posible crisis global impulsada por la inteligencia artificial resuenan con una urgencia innegable. La visión de una IA que "superará la masa del universo" es una llamada de atención sobre el crecimiento exponencial, la complejidad inmanejable y la autonomía de una tecnología que podría alterar fundamentalmente nuestra existencia. Si bien la IA ofrece promesas de progreso sin precedentes, también conlleva riesgos significativos en áreas como el empleo, la concentración de poder, la seguridad geopolítica y, en última instancia, el control de nuestro propio destino.

La tarea de abordar estos desafíos es monumental y requiere un esfuerzo concertado a nivel global. La regulación efectiva, la investigación en seguridad de la IA y un diálogo público informado son pilares esenciales para navegar este futuro incierto. La historia nos ha mostrado que el poder tecnológico, sin una gestión ética y responsable, puede llevar a consecuencias catastróficas. Es imperativo que, como sociedad, escuchemos estas advertencias y actuemos con la previsión necesaria para asegurar que la inteligencia artificial se desarrolle como un aliado de la humanidad, y no como la causa de su próxima gran crisis. Es nuestro deber colectivo garantizar que el futuro de la IA sea uno de prosperidad compartida y no de riesgo incontrolado.

Inteligencia Artificial Elon Musk Satya Nadella Crisis Global Futuro Tecnológico